音楽は振動というエネルギーです。そのエネルギーを捕らえ、可能な限り忠実に再生することが、オーディオ業界のすべてです。KEFの唯一の使命は、あらゆるソースからスピーカーに送られるエネルギーを、ソースが許す限り忠実に、正確に再現することです。ラウドスピーカーの上流では、音楽の世界がデジタル化されています。

音楽を簡単に楽しめるようにする技術は複雑かもしれませんが、少なくともその知識を得ることは簡単ではありません。そこで、ここでは「デジタル音楽入門」をご紹介します:

音楽を簡単に楽しめるようにする技術は複雑かもしれませんが、少なくともその知識を得ることは簡単ではありません。そこで、ここでは「デジタル音楽入門」をご紹介します:

人間の声やピアノ、ギター、ドラムなどの楽器は、すべてアナログの領域にあります。1880年代以降、私たちは、音楽エネルギーの振動を、その振動で操作しやすい媒体に転写する装置(ワックスシリンダー、アセテートレコード、磁気記録テープなど)を使って、音楽を記録・保存しました。

現代では、この振動をデジタルで取り込み、好きな音楽を好きな量だけ、どこにでも持ち運べるようになりました。音楽の演奏は、デジタルのビットの羅列に変換されるようになりました。そこからアナログに戻して聴くまで、整理された1と0の巨大な塊のままなのです。

アナログ演奏を録音したら、ADC(Analogue-to-Digital Converter)と呼ばれる回路に録音を送ります。ADCで音楽をデジタル化したら、1や0をデジタルファイルに移します。聴き返すときには、DAC(Digital-to-Analogue Converter)を通して、逆にデジタル化を解除するのです。そして、そのアナログ信号はアンプを通してスピーカーに送られます。

ADCは、信号の周波数(と振幅)を一定の割合でサンプリングし、そのサンプルをデジタル情報(2進数の1と0)に変換して、デジタルファイルとして保存します。

今、あなたが考えているどんな曲でも、その一切れを時間軸上に凍結させます。それがADCの仕事です。サンプリングされた音楽の解像度は、この1つの時間の切れ端をどう扱うかによって決まります。

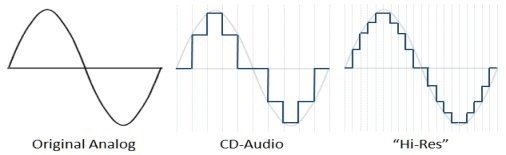

この1秒間の音楽を何回サンプリングするかということをサンプリングレートといいます。CDの規格であるRed Book CDでは、1秒間に44,100個のサンプリングが行われ、44.1kHzのサンプリングレートに相当します。当然ながら、サンプリング回数が多ければ多いほど、より多くの情報を保持できるため、ハイレゾの下限とされる96kHzのサンプリングレートは、44.1kHzよりは良いが、192kHzには及ばないということになります。

現代では、この振動をデジタルで取り込み、好きな音楽を好きな量だけ、どこにでも持ち運べるようになりました。音楽の演奏は、デジタルのビットの羅列に変換されるようになりました。そこからアナログに戻して聴くまで、整理された1と0の巨大な塊のままなのです。

アナログ演奏を録音したら、ADC(Analogue-to-Digital Converter)と呼ばれる回路に録音を送ります。ADCで音楽をデジタル化したら、1や0をデジタルファイルに移します。聴き返すときには、DAC(Digital-to-Analogue Converter)を通して、逆にデジタル化を解除するのです。そして、そのアナログ信号はアンプを通してスピーカーに送られます。

ADCは、信号の周波数(と振幅)を一定の割合でサンプリングし、そのサンプルをデジタル情報(2進数の1と0)に変換して、デジタルファイルとして保存します。

今、あなたが考えているどんな曲でも、その一切れを時間軸上に凍結させます。それがADCの仕事です。サンプリングされた音楽の解像度は、この1つの時間の切れ端をどう扱うかによって決まります。

この1秒間の音楽を何回サンプリングするかということをサンプリングレートといいます。CDの規格であるRed Book CDでは、1秒間に44,100個のサンプリングが行われ、44.1kHzのサンプリングレートに相当します。当然ながら、サンプリング回数が多ければ多いほど、より多くの情報を保持できるため、ハイレゾの下限とされる96kHzのサンプリングレートは、44.1kHzよりは良いが、192kHzには及ばないということになります。

オーディオ信号を表す下の正弦波を見ると、Y軸(上から下)は振幅または音量、X軸(左から右)は周波数または時間になります。

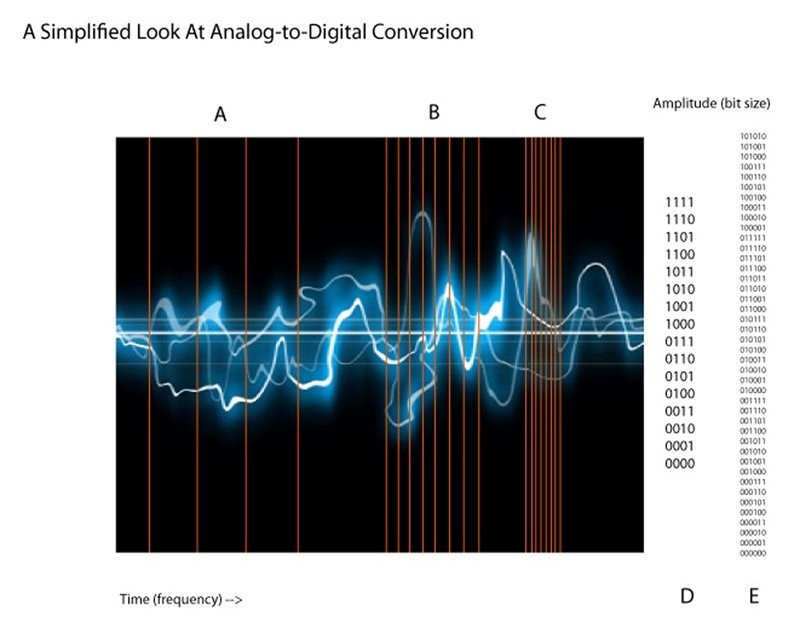

信号をデジタルに変換するために、Y軸のあらかじめ決められた部分にデジタル番号を割り当てますが、これがワードサイズになります。オーディオで一般的なワードサイズは、16ビットと24ビットです。次に、X軸に沿った信号のサンプルを取ります。サンプリングする回数はサンプルレートと呼ばれます(サンプリングすればするほど、良い音になります)。

デジタル領域では、情報をCDやハードドライブ、クラウド(実際には誰かが所有するハードドライブに過ぎません)に保存することができます。磁気テープやレコードは、単なるアナログ記憶装置です。

下の図は、相対的な参照点を用いてポイントを示すことで、変換プロセスを簡素化したものです。これは、アナログからデジタルへの変換を数学的に正確に描写するものではありません。

デジタル領域では、情報をCDやハードドライブ、クラウド(実際には誰かが所有するハードドライブに過ぎません)に保存することができます。磁気テープやレコードは、単なるアナログ記憶装置です。

下の図は、相対的な参照点を用いてポイントを示すことで、変換プロセスを簡素化したものです。これは、アナログからデジタルへの変換を数学的に正確に描写するものではありません。

縦の赤い線はサンプルレートを表しています。

Aの線は非常に遅いサンプルレートを示しており、音声信号の多くが省かれています。例えば、電話や携帯ラジオでは低いサンプルレートが使用され、非常に限られた周波数帯(人の声)がサンプリングされます。

Bは中サンプルレートを表します。このデモでは、44.1kHzのサンプルレートと言うことができ、Cはプロフェッショナルなアプリケーションに使用される非常に高いサンプルレートを表しています。CDや業務用オーディオのサンプリング規格は44.1kHzから始まりましたが、現在は48kHzが標準の最低サンプリングレートとされています。

Aの線は非常に遅いサンプルレートを示しており、音声信号の多くが省かれています。例えば、電話や携帯ラジオでは低いサンプルレートが使用され、非常に限られた周波数帯(人の声)がサンプリングされます。

Bは中サンプルレートを表します。このデモでは、44.1kHzのサンプルレートと言うことができ、Cはプロフェッショナルなアプリケーションに使用される非常に高いサンプルレートを表しています。CDや業務用オーディオのサンプリング規格は44.1kHzから始まりましたが、現在は48kHzが標準の最低サンプリングレートとされています。

しかし、気にしなければならないのはサンプルレートだけではありません。実は、言葉の長さの方が重要なのです。アナログの素晴らしい音楽を1や0に変換しているわけですから、1や0が多ければ多いほど、より詳細な情報が得られ、聞き返したときの音質が高くなるのは当然です。デジタル化された楽曲の音質を決めるのは、サンプリング数だけでなく、その情報をどれだけ保存しているかということです。ビット深度が深いほど(データワードが大きいほど)、解像度が高くなるのです。

レッドブックCDは16ビットのビット深度を使用しています。放送用ビデオの音声や高解像度とされるファイルの規格は24ビットです。特にダイナミクスはビット深度の影響を受けやすく、8ビットのデータを追加することで、音楽のパッセージのダイナミクスを維持する能力が大幅に向上します。

図の右側にある1と0は、サンプリングされた振幅のデジタル記録を表しています。特定の時間にサンプリングされ、その時の信号の振幅がデータとして保存されます。Dは4ビットの長さの小さなワードを表しています。たった4ビットのデータでは、サンプリングの回数にかかわらず、多くの振幅データを取り込むことができないことがおわかりいただけると思います。4ビットのデータでは、16種類のデータポイントしか取得できないのです。

E列の数値は6ビットのワードを表しています。6ビットで64点のデータを取得できるため、2ビット追加するだけで4倍の情報を取得できることになります。ワードが大きければ大きいほど、より詳細なサンプルを保存することができ、サンプルレートが高ければ高いほど、より多くのオーディオ信号をキャプチャすることができます。現実の世界では、16ビットのワードは65,536の別々のデータポイントを捕らえることができますが、8ビットを追加するだけで、24ビットのワードは16,777,216データポイント、つまり16ビットで捕らえるデータの256倍をサンプリングできるようになりました。

トレードオフはファイルサイズです。16ビットから24ビットに解像度を上げると、ファイルサイズも32分の1になります。ストレージが高価で限られていた時代には、使える量の音楽を保存するためには、より低い解像度が必要でした。しかし、携帯電話を除いて、ストレージは安価になり、かなり拡張できるようになったので、以前よりも多くのきちんとしたサウンドの音楽を保存できるようになりました。

そこで登場するのが、デジタル圧縮です。できるだけ小さなスペースに多くの音楽を収めるために、私たちはデジタルファイルを圧縮する方法を学びました。基本的には、曲のまとまりにとって絶対に必要でないデータを削除することです。基本的な音符や音は残っていますが、生命力やダイナミクスは取り除かれます。耳かきやコンピュータのスピーカーで聴けば、その欠落に気づくことはないでしょうが、より質の高いシステムで聴けば、欠落に気づくことは間違いないでしょう。

このことは、デジタルで情報を伝達する速度であるビットレートとは全く関係がありません。ビットレートとは、デジタル伝送システムがデータを伝送する能力のことです。ビットレートが高ければ高いほど、音楽や映像をストリーミング再生したときに、よりまとまりのあるものになります。デジタル伝送システムとは、CDをリッピングするためのソフトウェアであったり、音楽をストリーミングする際のローカルネットワークの速度であったり、デジタル音楽のストリームで行われるいくつかのデジタル伝送のいずれかであるかもしれません。

例えば、Spotifyのビットレートは、Android、iOS、デスクトップデバイス、アプリで、Premiumユーザーの場合は320kbpsと表示されています。Chromecastユーザーの場合、ビットレートは256kbpsに落ちます。品質に差はあるのでしょうか?はい、あります。その差(~70kbps)は顕著ですか?そうかもしれません。

Bluetooth APTxの潜在的なビットレートは325kbpsです(ソースに依存)。Apple AirPlayのビットレートは、使用するAACフォーマットで、250kbpsに制限されています。高音質なシステムでは、その差は顕著で、聴いていてかなりイライラしますが、中級以下のシステムに近づくにつれて、その差は識別しにくくなります。しかし、デジタル音楽のクオリティを語るには、他にも考慮すべき要素がいくつかある。

これらをまとめると、「数字が大きいほど、より良いリスニング体験ができる」ということになります。96kHzのサンプルレートは、48.1kHzのサンプルレートよりは良いが、192kHzには及ばない。24ビットのワード長は16ビットのワード長よりはるかに優れています(文字通り、品質が指数関数的に向上するのです)。250kbpsのビットレートは、320kbpsのビットレートよりも一般的に優れていません。

つまり、自分にとって良い音であれば良いのですが、自分が慣れ親しんだ音に限定してはいけないということです。科学は、マウスをクリックするだけで、素晴らしいサウンドの音楽という素晴らしい贈り物を私たちに与えてくれたのです。

レッドブックCDは16ビットのビット深度を使用しています。放送用ビデオの音声や高解像度とされるファイルの規格は24ビットです。特にダイナミクスはビット深度の影響を受けやすく、8ビットのデータを追加することで、音楽のパッセージのダイナミクスを維持する能力が大幅に向上します。

図の右側にある1と0は、サンプリングされた振幅のデジタル記録を表しています。特定の時間にサンプリングされ、その時の信号の振幅がデータとして保存されます。Dは4ビットの長さの小さなワードを表しています。たった4ビットのデータでは、サンプリングの回数にかかわらず、多くの振幅データを取り込むことができないことがおわかりいただけると思います。4ビットのデータでは、16種類のデータポイントしか取得できないのです。

E列の数値は6ビットのワードを表しています。6ビットで64点のデータを取得できるため、2ビット追加するだけで4倍の情報を取得できることになります。ワードが大きければ大きいほど、より詳細なサンプルを保存することができ、サンプルレートが高ければ高いほど、より多くのオーディオ信号をキャプチャすることができます。現実の世界では、16ビットのワードは65,536の別々のデータポイントを捕らえることができますが、8ビットを追加するだけで、24ビットのワードは16,777,216データポイント、つまり16ビットで捕らえるデータの256倍をサンプリングできるようになりました。

トレードオフはファイルサイズです。16ビットから24ビットに解像度を上げると、ファイルサイズも32分の1になります。ストレージが高価で限られていた時代には、使える量の音楽を保存するためには、より低い解像度が必要でした。しかし、携帯電話を除いて、ストレージは安価になり、かなり拡張できるようになったので、以前よりも多くのきちんとしたサウンドの音楽を保存できるようになりました。

そこで登場するのが、デジタル圧縮です。できるだけ小さなスペースに多くの音楽を収めるために、私たちはデジタルファイルを圧縮する方法を学びました。基本的には、曲のまとまりにとって絶対に必要でないデータを削除することです。基本的な音符や音は残っていますが、生命力やダイナミクスは取り除かれます。耳かきやコンピュータのスピーカーで聴けば、その欠落に気づくことはないでしょうが、より質の高いシステムで聴けば、欠落に気づくことは間違いないでしょう。

このことは、デジタルで情報を伝達する速度であるビットレートとは全く関係がありません。ビットレートとは、デジタル伝送システムがデータを伝送する能力のことです。ビットレートが高ければ高いほど、音楽や映像をストリーミング再生したときに、よりまとまりのあるものになります。デジタル伝送システムとは、CDをリッピングするためのソフトウェアであったり、音楽をストリーミングする際のローカルネットワークの速度であったり、デジタル音楽のストリームで行われるいくつかのデジタル伝送のいずれかであるかもしれません。

例えば、Spotifyのビットレートは、Android、iOS、デスクトップデバイス、アプリで、Premiumユーザーの場合は320kbpsと表示されています。Chromecastユーザーの場合、ビットレートは256kbpsに落ちます。品質に差はあるのでしょうか?はい、あります。その差(~70kbps)は顕著ですか?そうかもしれません。

Bluetooth APTxの潜在的なビットレートは325kbpsです(ソースに依存)。Apple AirPlayのビットレートは、使用するAACフォーマットで、250kbpsに制限されています。高音質なシステムでは、その差は顕著で、聴いていてかなりイライラしますが、中級以下のシステムに近づくにつれて、その差は識別しにくくなります。しかし、デジタル音楽のクオリティを語るには、他にも考慮すべき要素がいくつかある。

これらをまとめると、「数字が大きいほど、より良いリスニング体験ができる」ということになります。96kHzのサンプルレートは、48.1kHzのサンプルレートよりは良いが、192kHzには及ばない。24ビットのワード長は16ビットのワード長よりはるかに優れています(文字通り、品質が指数関数的に向上するのです)。250kbpsのビットレートは、320kbpsのビットレートよりも一般的に優れていません。

つまり、自分にとって良い音であれば良いのですが、自分が慣れ親しんだ音に限定してはいけないということです。科学は、マウスをクリックするだけで、素晴らしいサウンドの音楽という素晴らしい贈り物を私たちに与えてくれたのです。